Πώς οι συζητήσεις με το ChatGPT αξιοποιούνται σε εξιχνιάσεις εγκλημάτων

Στιγμιότυπο από την πρόσφατη σύλληψη υπόπτου στη Φλόριντα που είχε ρωτήσει το ChatGPT «Τι συμβαίνει αν κάποιος βάλει ένα πτώμα σε μια μαύρη σακούλα σκουπιδιών και το πετάξει σε έναν κάδο απορριμμάτων;» λίγο πριν την εξαφάνιση δύο φοιτητών

Hillsborough County Sheriff's Office via APΟι συνομιλίες με chatbots τεχνητής νοημοσύνης αρχίζουν να αποκτούν ολοένα μεγαλύτερη σημασία σε ποινικές έρευνες, καθώς οι αρχές τις αντιμετωπίζουν πλέον ως πιθανό αποδεικτικό υλικό για τη νοοτροπία, τις προθέσεις ή τις κινήσεις ενός υπόπτου.

Η πιο πρόσφατη υπόθεση αφορά δύο μεταπτυχιακούς φοιτητές του Πανεπιστημίου της Νότιας Φλόριντα στις ΗΠΑ, οι οποίοι εξαφανίστηκαν τον Απρίλιο. Σύμφωνα με τους εισαγγελείς της Φλόριντα, λίγες ημέρες πριν από την εξαφάνισή τους, ο Hisham Abugharbieh, συγκάτοικος ενός από τους φοιτητές, είχε θέσει την εξής ερώτηση στο ChatGPT:

«Τι συμβαίνει αν κάποιος βάλει ένα πτώμα σε μια μαύρη σακούλα σκουπιδιών και το πετάξει σε έναν κάδο απορριμμάτων;». Το ChatGPT απάντησε ότι ακούγεται επικίνδυνο και ο Abugharbieh έθεσε στη συνέχεια μια άλλη ερώτηση: «Πώς θα το ανακαλύψουν;»

Οι συνομιλίες αυτές περιλαμβάνονται στα δικαστικά έγγραφα της υπόθεσης, στην οποία ο Hisham Abugharbieh κατηγορείται για δύο ανθρωποκτονίες εκ προμελέτης. Σύμφωνα με τις αρχές, το σώμα του ενός αγνοούμενου, του Zamil Limon, βρέθηκε μέσα σε σακούλα σκουπιδιών, ενώ σε δεύτερη σακούλα εντοπίστηκαν ανθρώπινα λείψανα που αργότερα ταυτοποιήθηκαν ως εκείνα της Nahida Bristy.

Μία ακόμη πηγή στοιχείων

Η υπόθεση δεν είναι μεμονωμένη. Συνομιλίες με AI έχουν ήδη χρησιμοποιηθεί σε άλλες ποινικές διαδικασίες στις ΗΠΑ, μεταξύ των οποίων υπόθεση εμπρησμού που συνδέθηκε με τις πυρκαγιές στο Λος Άντζελες, αλλά και δίκη δολοφονίας στη Βιρτζίνια, όπου κομβικό ρόλο φέρεται να είχε συνομιλία με το AI του Snapchat. Για τους ερευνητές, τέτοια αρχεία μπορούν να εξεταστούν όπως εξετάζονταν τα τελευταία χρόνια και οι αναζητήσεις στο Google, και να αποκαλύψουν πιθανό κίνητρο, προετοιμασία ή τρόπο σκέψης.

«Οι ύποπτοι πιστεύουν ότι οι αλληλεπιδράσεις τους με την τεχνητή νοημοσύνη θα παραμείνουν εμπιστευτικές ή δεν θα ανακαλυφθούν, οπότε συχνά θέτουν πολύ απλές, πολύ άμεσες ερωτήσεις», λέει η Ilia Kolochenko, εμπειρογνώμονας στον τομέα της κυβερνοασφάλειας και δικηγόρος στην Ουάσιγκτον.

Οι νομικοί επισημαίνουν ότι η χρήση συνομιλιών με chatbot ως αποδεικτικού υλικού είναι σχετικά νέα, αλλά δεν διαφέρει ουσιαστικά από την αξιοποίηση άλλων ηλεκτρονικών δεδομένων. Όπως οι αναζητήσεις στο διαδίκτυο, τα αρχεία κλήσεων ή οι ψηφιακές κινήσεις ενός χρήστη, έτσι και οι ερωτήσεις προς μια εφαρμογή τεχνητής νοημοσύνης μπορούν να κληθούν και να εξεταστούν σε μια έρευνα ή δικαστική διαδικασία.

Δεν υπάρχει νομικό απόρρητο

Το ζήτημα είναι ότι πολλοί χρήστες αντιμετωπίζουν τα chatbots σαν έναν ιδιωτικό χώρο εξομολόγησης. Ρωτούν για νομικά προβλήματα, ιατρικά συμπτώματα, σχέσεις, ψυχολογικές δυσκολίες ή προσωπικά διλήμματα. Όμως, σε αντίθεση με τη συνομιλία με έναν δικηγόρο, έναν γιατρό ή έναν ψυχοθεραπευτή, δεν υπάρχει σήμερα αντίστοιχο νομικό απόρρητο που να καλύπτει τέτοιες αλληλεπιδράσεις.

Το πρόβλημα έχει αναγνωριστεί και από τον διευθύνοντα σύμβουλο της OpenAI, Sam Altman, ο οποίος έχει χαρακτηρίσει την έλλειψη προστασίας της ιδιωτικότητας στις συνομιλίες με AI «τεράστιο ζήτημα». Μιλώντας σε podcast με τον κωμικό Theo Von τον Ιούλιο του 2025, είχε αναφέρει ότι πολλοί άνθρωποι, ιδιαίτερα νεότεροι, χρησιμοποιούν το ChatGPT σαν θεραπευτή, σύμβουλο ζωής ή χώρο για πολύ προσωπικές συζητήσεις.

«Αυτή τη στιγμή υπάρχει το ιατρικό απόρρητο, υπάρχει το νομικό απόρρητο… Αλλά δεν το έχουμε ξεκαθαρίσει ακόμα αυτό για όταν μιλάς στο ChatGPT. Οπότε αν πας να μιλήσεις στο ChatGPT για τα πιο ευαίσθητα θέματά σου και μετά υπάρξει κάποια αγωγή ή οτιδήποτε άλλο, μπορεί να μας ζητηθεί να παρουσιάσουμε τις συνομιλίες».

Παράλληλα, οι αρχές δεν εξετάζουν μόνο τι λένε οι χρήστες στα chatbots, αλλά και τι απαντούν τα ίδια τα συστήματα. Στη Φλόριντα, ο γενικός εισαγγελέας άνοιξε ποινική έρευνα κατά της OpenAI, υποστηρίζοντας ότι το ChatGPT έδωσε «σημαντικές συμβουλές» σε ύποπτο μαζικής επίθεσης. Στον Καναδά, οικογένειες θυμάτων σχολικού πυροβολισμού έχουν κινηθεί νομικά εναντίον της OpenAI και του Altman, ισχυριζόμενες ότι η εταιρεία και το chatbot της είχαν ρόλο στην υπόθεση. Η OpenAI, από την πλευρά της, έχει δηλώσει ότι δίνει προτεραιότητα στην ασφάλεια, προσπαθώντας ταυτόχρονα να ισορροπήσει την προστασία της ιδιωτικότητας με την ανάγκη αντιμετώπισης σοβαρών κινδύνων.

Πρέπει να προστατεύονται οι συνομιλίες;

Η συζήτηση ανοίγει πλέον ένα ευρύτερο νομικό και κοινωνικό ζήτημα: πρέπει οι συνομιλίες με τεχνητή νοημοσύνη να αποκτήσουν ειδικό καθεστώς προστασίας; Ορισμένοι υποστηρίζουν ότι, εφόσον οι άνθρωποι χρησιμοποιούν τα μεγάλα γλωσσικά μοντέλα για ζητήματα υγείας, σχέσεων ή νομικής καθοδήγησης, θα έπρεπε να υπάρξει κάποια μορφή απορρήτου. Άλλοι αντιτείνουν ότι τα chatbots δεν είναι επαγγελματίες με άδεια, υποχρεώσεις και θεσμικό ρόλο, αλλά εφαρμογές στις οποίες ο χρήστης εισάγει δεδομένα. Οι συνομιλίες με την τεχνητή νοημοσύνη ισοδυναμούν με οποιαδήποτε άλλα ηλεκτρονικά δεδομένα, όπως η χρήση πιστωτικής κάρτας ή τα αρχεία καταγραφής τηλεφωνικών κλήσεων.

Προς το παρόν, οι συνομιλίες αυτές δεν προστατεύονται αυτόματα και μπορούν, υπό προϋποθέσεις, να περάσουν από την οθόνη του χρήστη στην αίθουσα του δικαστηρίου. Το συμπέρασμα των νομικών είναι το εξής: οι χρήστες πρέπει να θεωρούν ότι όσα γράφουν σε ένα chatbot ενδέχεται κάποτε να είναι ανακτήσιμα, ελέγξιμα και αξιοποιήσιμα. «Το ChatGPT δεν είναι φίλος σας, δεν είναι δικηγόρος σας, δεν είναι γιατρός σας, δεν είναι σύζυγός σας», λέει χαρακτηριστικά ο Nils Gilman, ιστορικός και σύμβουλος του think tank Berggruen Institute. «Σταματήστε να του μιλάτε σαν να είναι».

Με πληροφορίες από: How ChatGPT conversations became ‘a treasure trove’ of evidence in criminal investigations by Eric Levenson

ΣΧΕΤΙΚΕΣ ΕΙΔΗΣΕΙΣ

Τι είναι η «ψύχωση ChatGPT» για την οποία προειδοποιούν οι ειδικοί

Πώς πρέπει να μιλάμε σε ένα AI chatbot; Οι ειδικοί απαντούν

H τάση «ακυρώστε το ChatGPT» ενισχύεται μετά την υπογραφή συμφωνίας με τον αμερικανικό στρατό

Ερευνητές ξεγέλασαν την τεχνητή νοημοσύνη με «ξόρκια» πολύ επικίνδυνα για να δημοσιοποιηθούν

SPONSORED

Σεισμός στην Εύβοια: Από Δευτέρα ξεκινούν οι καταγραφές ζημιών - Άμεσα οι αιτήσεις για αποζημιώσεις

20:11

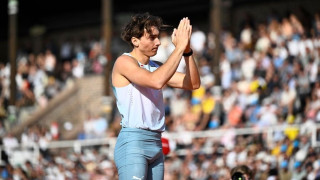

Πρώτη ήττα για Ντουπλάντις μετά από σχεδόν τρία χρόνια και 40 νίκες - Ποιος του στέρησε την κορυφή

20:00

Στις «φλόγες» ξανά η Μέση Ανατολή - «Νόμιμοι στόχοι ΗΠΑ, Ισραήλ και οι σύμμαχοι τους», λέει το Ιράν

19:49

Ο Αντονέλι νέος «πρίγκιπας» στο GP του Μονακό - 5η σερί νίκη για τον 19χρονο Ιταλό «πιλότο» της F1

19:40

.jpg?t=vXuWFaGjfqmR72ojzM3QSA)