Τεχνητή νοημοσύνη και αναγνώριση προσώπου: Quo vadis?

Έχουν περάσει 8 χρόνια από τον θάνατο ενός από τους μεγαλύτερους ιστορικούς του 20ου αιώνα, του Έρικ Χοσμπάουμ και δεν μπορεί παρά να αναρωτηθεί κανείς: Mε τι θα καταπιανόταν η πένα του μεγάλου διανοητή βιώνοντας τα γεγονότα των ημερών μας; Ποιά γεγονότα θα φώτιζαν τις σελίδες ενός καινούριου “Interesting Times: A Twentieth-Century Life” με αναφορά στον αιώνα μας;

Yποθέτω ότι ο Χοσμπάουμ θα αφιέρωνε μεγάλο μέρος της αφήγησης του στην τεχνητή νοημοσύνη και στην αμφιλεγόμενη τεχνολογία αναγνώρισης προσώπου, στην διαχείριση της πανδημίας του νέου κορωνοϊού, στις αντιρατσιστικές διαδηλώσεις με αφορμή τη δολοφονία του Αφροαμερικανού Τζορτζ Φλόιντ.

Κι όλα τα παραπάνω συνδέονται άρρηκτα μεταξύ τους στον συμπυκνωμένο ιστορικό χρόνο που βιώνουμε όλοι συνειδητά ή ασυνείδητα.

Το «όχι» των Microsoft, IBM και Amazon

Στο όνομα της καταπολέμησης της πανδημίας, η παρακολούθηση των πολιτών με τη χρήση συστημάτων αναγνώρισης προσώπων εντατικοποιήθηκε, ιδιαίτερα σε χώρες όπως η Ρωσία και η Kίνα, προκαλώντας κύμα ανησυχιών σχετικά με τη συνέχιση τους ακόμα και μετά το πέρας της πανδημίας.

Η Τεχνολογία Αναγνώρισης Προσώπου (facial recognition technology) είναι μια από τις πλέον δημοφιλείς βιομετρικές τεχνολογίες, μαζί με την σάρωση δακτυλικού αποτυπώματος και της ίριδας, που μπορεί να αναγνωρίσει ένα άτομο μέσω της ψηφιακής του απεικόνισης με τη χρήση τεχνητής νοημοσύνης.

Οι εφαρμογές της συγκεκριμένης τεχνολογίας είναι ευρείες και δεν περιορίζονται στην καταπολέμηση του εγκλήματος από τις αστυνομικές αρχές αλλά χρησιμοποιούνται, μεταξύ άλλων, στη διαδικασία προσλήψεων ακόμη και από εταιρίες όπως η ισπανική Emotion Research Lab. που υποστηρίζουν ότι μπορούν να εκμαιεύσουν τα πολιτικά μας πιστεύω με τη δύναμη των αλγορίθμων.

Η συζήτηση γύρω από τα γκρίζα-προβληματικά σημεία σχετικά με τη χρήση αυτής της τεχνολογίας επανήλθε ακόμη πιο έντονη στον απόηχο της δολοφονίας του αφροαμερικανού Τζορτζ Φλόϊντ και του μεγάλου κύματος των διαδηλώσεων που ξέσπασαν στις ΗΠΑ αλλά και διεθνώς.

Από την μία πλευρά η ακριβής χρήση και αποθήκευση των προσωπικών χαρακτηριστικών εκατομμυρίων ανθρώπων σε μεγάλες βάσεις δεδομένων δημιουργεί δικαιολογημένα ερωτηματικά, ελλείψει συγκεκριμένου νομοθετικού πλαισίου. Από την άλλη πλευρά, έρευνες δείχνουν συστηματικά την ύπαρξη τεχνικών προβλημάτων στην αρχιτεκτονική συστημάτων αναγνώρισης προσώπου, διότι ακόμα και τα πιο εξελιγμένα εξ αυτών αποδείχθηκε ότι παρουσιάζουν μεροληψία εις βάρος των μαύρων και των γυναικών.

Ένα αντιπροπσωπευτικό παράδειγμα είναι η γαλλική εταιρία Idemia, που αναπτύσσει λογισμικό αναγνώρισης προσώπου με πελάτες τις κρατικές αρχές σε ΗΠΑ, Αυστραλία και Γαλλία. Το συγκεκριμένο λογισμικό χρησιμοποιείται για τον έλεγχο επιβατών σε κρουαζιερόπλοια που καταφθάνουν στις ΗΠΑ και ελέγχονται για παράβαση των κανόνων τελωνειακής και συνοριακής προστασίας. Τον Ιούλιο του 2019, το Εθνικό Ινστιτούτο Τυποποίησης και Τεχνολογίας των ΗΠΑ, (National Institute of Standards and Technology) ανέδειξε, μέσω σχετικών ελέγχων λάθη στην αναγνώριση προσώπων που ανήκαν σε μαύρους από πέντε έως και δέκα φορές περισσότερο σε σχέση με τους λευκούς.

Πέρυσι το Σαν Φρανσίσκο, όπως και το Όκλαντ και το Σόμερσβιλ της Μασαχουσέτης, απαγόρευσαν στις αστυνομικές αρχές να χρησιμοποιούν συστήματα αναγνώρισης προσώπου.

Η επαναφορά του υπαρκτού προβλήματος της ρατσιστικής βίας στις ΗΠΑ μετά τη δολοφονία του Φλόιντ αλλά και τις έντονες αντιδράσεις από οργανώσεις ανθρωπίνων δικαιωμάτων φαίνεται να οδήγησαν σε ένα μπαράζ ανακοινώσεων από τους τεχνολογικούς κολοσσούς Microsoft, IBM και Αmazon ότι σταματούν να παρέχουν τέτοιου είδους τεχνολογία στις αστυνομικές αρχές των ΗΠΑ.

Τόσο η ΙΒΜ και η Microsoft ζητούν την θέσπιση εθνικού νόμου για τη χρήση της συγκεκριμένης τεχνολογίας ενώ με τη σειρά της η Amazon δήλωσε ότι διακόπτει την πώληση του δικού της συστήματος αναγνώρισης προσώπου, του Rekognition για τον επόμενο χρόνο.

Παρ’ όλα αυτά, παραμένει προς το παρόν άγνωστο τι προτιθεται να κάνει η Amazon με την διάθεση του προϊόντος της σε στρατιωτικές δυνάμεις, υπηρεσίας κατασκοπίας και άλλες υπηρεσίες επιβολής του νόμου.

Σύμφωνα με ρεπορτάζ του TechCrunch, η Microsoft προσπάθησε να πουλήσει το σύστημα αναγνώρισης προσώπου στο Τμήμα Δίωξης Ναρκωτικών των ΗΠΑ, όπως φάινεται από σχετική αλληλογραφία στην οποία απέκτησε πρόσβαση το ACLU (American Civil Liberties Union) το διάστημα μεταξύ Σεπτεμβρίου 2017 και Δεκεμβρίου 2018. Σύμφωνα με τον Nathan Freed Wessler, δικηγόρο του ACLU, η Microsoft δεν έχει απαντήσει μέχρι στιγμής αν θα διαθέτει εφεξής τη συγεκριμένη τεχνολογία σε ομοσπονδιακές υπηρεσίες όπως το Τμήμα Δίωξης Ναρκωτικών.

Προσωπικές ελευθερίες σε προκρούστια κλίνη;

Η τεχνητή νοημοσύνη αποτελεί εδώ και καιρό το νέο πεδίο ανταγωνισμού μεταξύ ΗΠΑ και Κίνας.

Στον «θαυμαστό καινούργιο κόσμο» που έρχεται, για τον οποίο έγραφε αρκούντως δυστοπικά ο συγγραφέας επιστημονικής φαντασίας Άλντους Χάξλεϋ, ΗΠΑ και Κίνα κοντροχτυπιούνται στο ποιός θα είναι η επόμενη τεχνολογική δύναμη στον συγκεκριμένο τομέα.

Σ’ αυτή την ιστορική συγκυρία η Ευρωπαϊκή Ένωση οφείλει να απαντήσει πρωτίστως με την δημιουργία ενός αυστηρού ρυθμιστικού πλαισίου αρχών για τη διασφάλιση των ανθρωπίνων δικαιωμάτων και των προσωπικών ελευθεριών.

Τον Ιανουάριο, η Ευρωπαϊκή Επιτροπή, σε ένα διαρρεύσαν σχέδιο Λευκής Βίβλου για την Τεχνητή Νοημοσύνη εξέταζε μέτρα για την προσωρινή απαγόρευση σχετικών τεχνολογιών (π.χ. 3-5 χρόνια) που χρησιμοποιούνται τόσο από τους δημόσιους όσο και από τους ιδιωτικούς φορείς, με στόχο να αξιολογηθούν πλήρως οι αρνητικές επιπτώσεις και να αναπτυχθούν μέτρα διαχείρισης των επιμέρους κινδύνων.

Κάτι τέτοιο θα μπορούσε να σημάνει το τέλος σε εν εξελίξει έργα τεχνητής νοημοσύνης σε ορισμένες χώρες της ΕΕ, όπως στη Γερμανία που επιθυμεί να εφαρμόσει τεχνολογία αναγνώρισης προσώπου σε 134 σιδηροδρομικούς σταθμούς και 14 αεροδρόμια.

Παρ’όλα αυτά, στο τελικό επίσημο έγγραφο που εξέδωσε η Επιτροπή, δεν συμπεριελήφθη καμία απαγόρευση ή έστω περιορισμός παρά μόνο μία γενική διατύπωση ότι η Ευρωπαϊκή Επιτροπή επιθυμεί να δρομολογήσει έναν εκτεταμένο διάλογο, ο οποίος θα μπορούσε να δικαιολογήσει εξαιρέσεις στη μαζική αναγνώριση προσώπου στο μέλλον, εφόσον χρειαστεί.

Τις προηγούμενες μέρες το Ευρωπαϊκό Συμβούλιο Προστασίας Δεδομένων αναφέρθηκε στην δραστηριότητα μιας σκιώδους εταιρίας που ακούει στο όνομα Clearview AI. Η Clearview AI έχει συλλέξει από δημόσια προσβάσιμες πηγές του Διαδικτύου οπως Facebook, Google κ.ο.κ. 3 δισεκατομμύρια φωτογραφίες πολιτών και τις πουλάει σε αστυνομικές αρχές και κυβερνητικούς οργανισμούς με την εφαρμογή αναγνώρισης προσώπου που έχει αναπτύξει. Σύμφωνα με τον Ευρωπαϊκό Συμβούλιο Προστασίας Δεδομένων, η δραστηριότητα της Clearview AI (μάλλον) αντιτίθεται στους νόμους περί προστασίας προσωπικών δεδομένων στην Ευρώπη.

Οι αντιδράσεις για τις πρακτικές της εν λόγω εταιρίας είναι πολυπληθείς κι είχαν ήδη ξεκινήσει από τον Ιανουάριο του 2020 με αφορμή σχετικό δημοσίευμα των New York Times. Παρ’ όλα αυτά, η εν λόγω εταιρεία συνεχίζει να πουλά το αμφιλεγόμενο λογισμικό σε αστυνομικές αρχές ενώ έχει επεκτείνει την πελατειακή της βάση και σε χώρες εκτός των ΗΠΑ, όπως το Βέλγιο, η Δανία, η Φινλανδία, Γαλλία, Αγγλία, Ισπανία, Ιρλανδία, Ιταλία, Ολλανδία, Νορβηγία κ.α.

Aς ελπίσουμε ότι η ίδια η δυναμική της Ιστορίας, όπως γράφεται αυτές τις μέρες στις ΗΠΑ και στον κόσμο, θα οδηγήσει τις κοινωνίες του σήμερα να σταματήσουν επιτέλους να αγνοούν τον μεγάλο ελέφαντα στο δωμάτιο, όσον αφορά στην τεχνητή νοημοσύνη και τις πραγματικές επιπτώσεις της στις ζωές μας.

Το ζήτημα είναι πολιτικό και εξόχως σημαντικό, διότι θα καθορίσει και την απάντηση στο δίπολο «Δυστοπία ή Ουτοπία» για τις ανθρώπινες κοινωνίες του μέλλοντος.

* Η Ελένη Νάτση είναι δημοσιογράφος, Marketing & Communications manager με ειδίκευση στον τεχνολογικό κλάδο, μέλος του Advanced Media Institute του Ανοικτού Πανεπιστημίου Κύπρου.

SPONSORED

Το Ισραήλ ζητά από τους κατοίκους της Τύρου στον Λίβανο να εκκενώσουν την περιοχή

15:00

Οι τέσσερις τρόποι με τους οποίους η ποδηλασία βελτιώνει την υγεία του εγκεφάλου

14:48

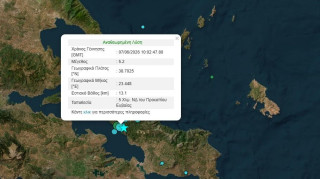

Εύβοια: Σε ετοιμότητα για καταγραφή ζημιών από τους σεισμούς - Περιπολίες από την Πυροσβεστική

14:28

Βίντεο από τους σεισμούς στην Εύβοια: Η στιγμή της ισχυρής δόνησης των 5,2 Ρίχτερ

14:23