Φωνές για «φρένο» στην Τεχνητή Νοημοσύνη: Οι κίνδυνοι και ο προβληματισμός στην Ευρώπη

Ανανεώθηκε:

Το 2023 θα μπορούσε να χαρακτηριστεί ως η χρονιά της «τεχνητής νοημοσύνης» ή απλά AI (από τα αρχικά των αγγλικών λέξεων artificial intelligence).

Η διάθεση στο ευρύ κοινού του ChatGPT της OpenAI που ανέδειξε τις δυνατότητες που έχει η τεχνητή νοημοσύνη ήταν -τρόπον τινά- η εξέλιξη που έφερε το ΑΙ στο διεθνές προσκήνιο με αποτέλεσμα οι συζητήσεις γύρω από την αξιοποίηση του αλλά και τα επόμενα βήματα που πρέπει να γίνουν σε πολιτικό και κοινωνικό επίπεδο να ενταθούν.

Δεν είναι τυχαίο ότι τις τελευταίες εβδομάδες το ΑΙ βρίσκεται πολύ ψηλά στην ατζέντα της παγκόσμιας επικαιρότητας και οι εκκλήσεις για «επιβράδυνση» του ρυθμού με τον οποίο προχωρά η έρευνα για τις εφαρμογές τεχνητής νοημοσύνης. Η ανοικτή επιστολή του Future of Life Institute, το οποίο θεωρείται από τα πλέον σημαντικά στον συγκεκριμένο χώρο, προκάλεσε ιδιαίτερη αίσθηση. Ιδίως από τη στιγμή που έφερε την υπογραφή του Elon Musk. Συνολικά, τη συγκεκριμένη επιστολή έχουν υπογράψει περισσότερα από 22.000 άτομα, στα οποία περιλαμβάνονται αρκετές από τις πιο γνωστές προσωπικότητες σε παγκόσμιο επίπεδο.

Παράλληλα, η απόφαση των ιταλικών αρχών να απαγορεύσουν στην OpenAI να επεξεργάζεται τα δεδομένα των Ιταλών πολιτών προκειμένου να μπορούν να χρησιμοποιηθούν στην πλατφόρμα του ChatGPT, ήταν ένα ακόμη σημάδι όσον αφορά την ανησυχία που υπάρχει. Και είναι αξιοσημείωτο ότι αρκετές ακόμη χώρες του δυτικού κόσμου, όπως η Γαλλία και η Γερμανία συζητούν για το αν θα πρέπει να επιβάλλουν άμεσα περιορισμούς στη χρήση του ChatGPT, το οποίο μπορεί να οδηγήσει στην παραγωγή περιεχομένου παραπληροφόρησης, αλλά και γενικότερα όσον αφορά στη χρήση των εφαρμογών του αποκαλούμενου generative AI.

Στο ίδιο μήκος κύματος είναι και οι προειδοποιήσεις από εταιρείες κυβερνοασφάλειας όπως είναι η CheckPoint, η ESET και η Kaspersky για το πως το ChatGPT και τα υπόλοιπα αντίστοιχα ΑΙ εργαλεία αξιοποιούνται από τους κυβερνοεγκληματίες αλλά και οργανισμούς που προωθούν την παραπληροφόρηση.

Αυτό που πρέπει να σημειωθεί είναι πως η συζήτηση για το ΑΙ και οι επιπτώσεις του δεν είναι καινούρια. Την τελευταία πενταετία, υπάρχουν ένας μεγάλος σκεπτικισμός μεταξύ ανθρώπων που ασχολούνται με τις ψηφιακές τεχνολογίες για τους κινδύνους που ελλοχεύει η εκρηκτική ανάπτυξη της τεχνητής νοημοσύνης.

«Η τεχνητή νοημοσύνη διαμορφώνει και ένα νέο τρόπο αντίληψης, που θέτει επί τάπητος κομβικά ερωτήματα για το παρόν και το μέλλον του είδους μας και του πολιτισμού του» επισημαίνει στο CNN Greece, ο Χρήστος Παπαδόπουλος, διευθύνων σύμβουλος της εταιρείας Witside, η οποία αξιοποιεί την τεχνητή νοημοσύνη για την ανάπτυξη καινοτόμων λύσεων για επιχειρήσεις.

Το παρελθόν έχει δείξει ότι είναι δύσκολο να βάλει κανείς φρένο στην τεχνολογική εξέλιξη. Όπως έχει δείξει ότι η τεχνολογία δεν είναι «καλή» ή «κακή» αλλά εξαρτάται από το πως την χρησιμοποιούν οι άνθρωποι. Στην περίπτωση του ΑΙ, ένα βασικό ζήτημα που έγινε προφανές με το ChatGPT ήταν ότι έκανε την εμφάνιση του και άρχισε να γίνεται δημοφιλές χωρίς κανένα έλεγχο. «Οι επιφυλάξεις ενισχύονται από την αδιαφάνεια και την αδυναμία κατανόησης αυτών των συστημάτων που χαρακτηρίζονται από αυτονομία. Οι πιθανές αρνητικές επιπτώσεις επιτείνονται, εξαιτίας της μεγάλης ασυμμετρίας ισχύος μεταξύ εκείνων που αναπτύσσουν και εφαρμόζουν αλγοριθμικά συστήματα και των χρηστών ή όσων υφίστανται τα αποτελέσματα αυτών των συστημάτων. Η εναπόθεση των κανόνων ανάπτυξης της τεχνητής νοημοσύνης στις Big Tech είναι καλή είδηση για τις ίδιες, όχι όμως για την κοινωνία» τονίζει ο κ. Παπαδόπουλος, υποστηρίζοντας ουσιαστικά ότι θα πρέπει να βρούμε έναν τρόπο να θέσουμε κανόνες όσον αφορά στην αξιοποίηση του ΑΙ.

H θέσπιση κανόνων και γενικότερα ενός ρυθμιστικού πλαισίου για την τεχνητή νοημοσύνη είναι γενικά το θέμα που βρίσκεται πιο ψηλά από οποιοδήποτε άλλο στην παγκόσμια συζήτηση για το ΑΙ. Η Ευρωπαϊκή Ένωση έχει ξεκινήσει τις σχετικές συζητήσεις, όπως και άλλα από τα μεγάλα κράτη του πλανήτη. Το πρόβλημα είναι ότι για να δημιουργηθεί το εν λόγω ρυθμιστικό πλαίσιο απαιτείται χρόνος και το ερώτημα είναι τι θα γίνει στο ενδιάμεσο.

Για παράδειγμα, η τελευταία γενιά της πλατφόρμας GPT της OpenAI, το GPT 4, έγινε διαθέσιμη πριν από μερικές εβδομάδες και μία βασική διαφορά της ήταν ότι -σε σχέση με το GPT 3.5- είχε πολύ περισσότερους περιορισμούς όσον αφορά στον τρόπο που μπορεί να τη χρησιμοποιεί κάποιος πολίτης. Όμως, σε ελάχιστο χρονικό διάστημα μπορούσε να βρει κανείς εύκολα και γρήγορα τρόπους προκειμένου να παρακάμψει αυτούς τους περιορισμούς. Και αυτό είναι κάτι που προκαλεί μεγαλύτερη ανησυχία.

Σε κάθε περίπτωση, το ΑΙ είναι πλέον εδώ και θα μας απασχολήσει πολύ τα επόμενα χρόνια. Το ρυθμιστικό πλαίσιο είναι απαραίτητο αλλά αυτό που πρέπει να γίνει κατανοητό είναι πως η τεχνητή νοημοσύνη είναι κάτι πολύ διαφορετικό ως εξέλιξη σε σχέση με ότι έχουμε βιώσει στο παρελθόν. Κάτι που σημαίνει και απαιτεί και έναν διαφορετικό τρόπο αντιμετώπισης.

SPONSORED

Βίντεο - ντοκουμέντο: Μέσα στο σπίτι που νοίκιαζε ο 37χρονος Παλαιστίνιος στα Πατήσια - Τι βρέθηκε

13:17

Δύο ισχυροί σεισμοί 4,8 και 5,2 Ρίχτερ στην Εύβοια: Κατολισθήσεις στο Μαντούδι- Αισθητοί στην Αττική

13:01

Η Ρωσία έπληξε υποδομή πυρηνικού καυσίμου κοντά στο Τσερνόμπιλ

12:57

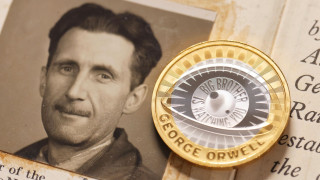

Η βρετανική «ουτοπική πόλη» που ο Τζορτζ Όργουελ...απεχθανόταν

12:52